我们知道,AI将在很长一段时间占据互联网技术时代的风口。但是,有代码的地方就有缺陷,随着AI技术在安全领域的运用,AI对安全产业起到了极大的赋能作用,但自身安全问题也随之上升到前所未有的高度,更糟糕的是AI极有可能会成为攻击者的利器。

AI被攻击者滥用

How AI inference threats might influence the out come of 2020 election报告指出:AI算法和代码的设计都依赖编程人员的判断与选择,因此极容易被利益集团操纵。

- 网络攻击者使用AI分析防御机制,模拟行为模式以绕过安全控制,利用分析和机器学习进行黑客攻击,并且制造深度伪造内容,包括视频、音频和文本记录等。据了解,AI已经可以通过改变社交媒体上的舆论导向来操纵选民的投票行为,破坏选民的政治情感中立性,从而影响最终的选举结果。伪造视频将一个人的动作和语言叠加到另一个人身上,造成煽动政治暴力等严重后果,而AI的加入使深度造假难以检测。

- 帮助黑客更方便地绕过传统的安全工具。例如DeepLocker的新型攻击工具能够绕过传统的安全工具,在设备中安装勒索软件或其他恶意软件。SCYTHE推出了SCYTHE Marketplace,该平台使受信任的第三方开发人员能够为公司的攻击仿真平台创建新功能。红色、蓝色和紫色团队可以使用创建的模块来模拟某些类型的攻击并测试其防御。这两年绿盟科技一直致力于构建网络安全对抗演练系统,一方面在安全培训时提供模拟演练,另一方面验证安全防御方案的有效性并进行防御方案的学习推荐。

但是我们不能因为担心而阻碍AI的发展,人永远是技术的主宰,正如大会主题“人的因素”,才是网络安全的意义所在。

AI赋能安全自动化和智能化

人工智能和机器学习的进步正在为网络安全的技术进步提供助力,以大数据、安全分析、深度学习、人机协同为代表的AI与网络安全融合实践日益增多,比如威胁情报、威胁检测与分析、智能安全平台等。

在这个大数据时代,越来越多的安全企业将威胁数据作为核心资产。FireEye推出FireEye Mandian threat Intelligence Suite,提供威胁情报订阅相关服务;Palo Alto Networks推出CortexXSOAR集成威胁情报管理与SOAR功能;CrowdStrike利用威胁情报提供端点恢复服务,帮助组织在被入侵后恢复业务运营。威胁情报是打造基于情报的安全服务和平台的关键所在,对威胁数据进行挖掘分析、深入追踪,才可能真正地解决安全问题。

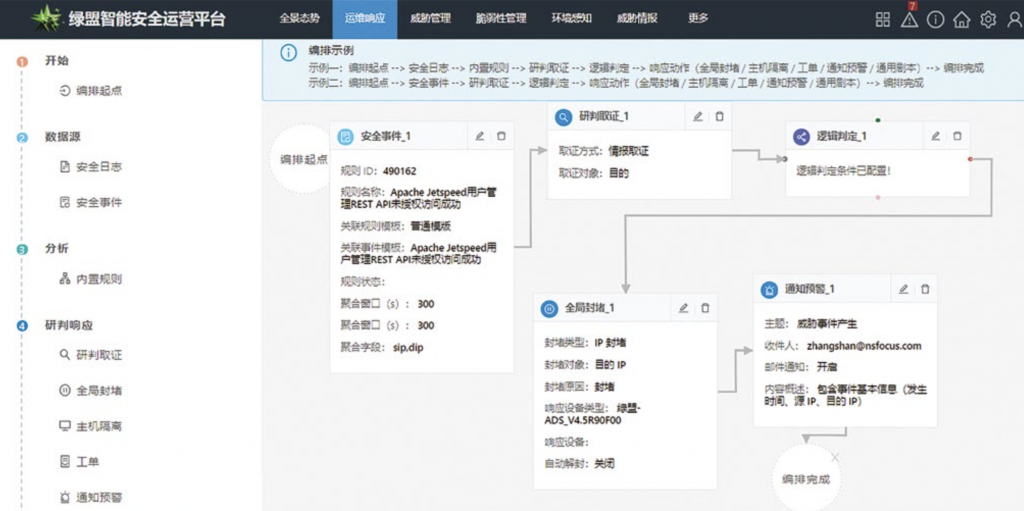

融合各种异构威胁数据,将历史性本地日志、全球威胁态势和实时发生的事件流放在一起构建安全知识图谱,打造从感知—决策—响应提供闭环管理的安全运营平台和解决方案。

RSA 2020大会上,思科推出SecureX平台整合不同的安全产品,自动化安全分析和处置,加快威胁检测和响应速度。Fortinet发布的FortiAI利用深度神经网络实现对复杂决策场景的学习,原有安全专家处理的威胁分析、事件调查和威胁溯源等一系列耗时任务转为自动化执行,因此安全专家能够聚焦到更有价值的任务中。可见,AI/ML技术提供智能分析和决策能力,被运用在安全运营流程的自动化上。

AI技术在威胁情报、安全分析和智能决策等方面的优势为应对动态多变、复杂交织的网络安全问题提供新思路。安全领域已经成为AI应用的重要领域之一。

AI+网络安全

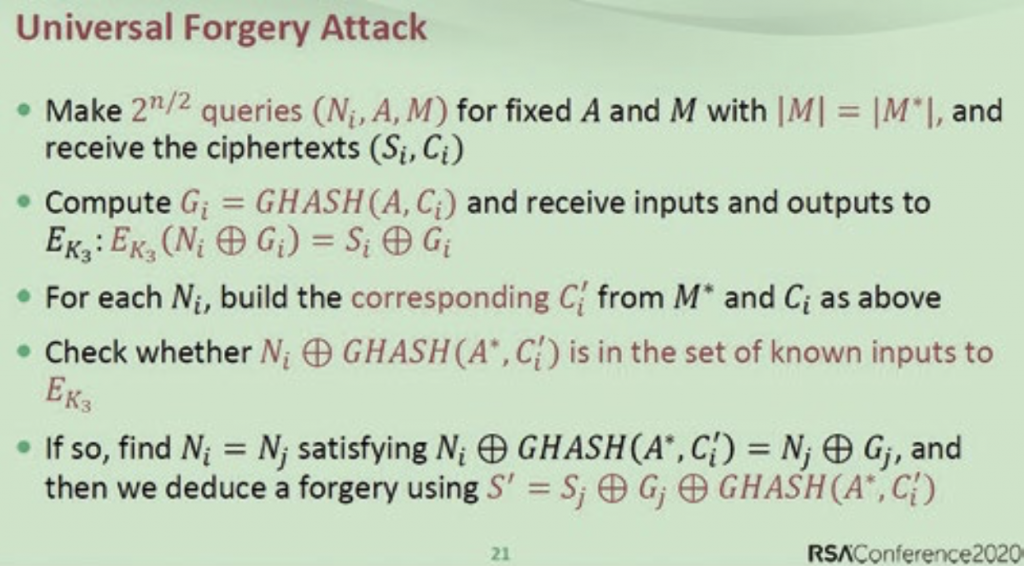

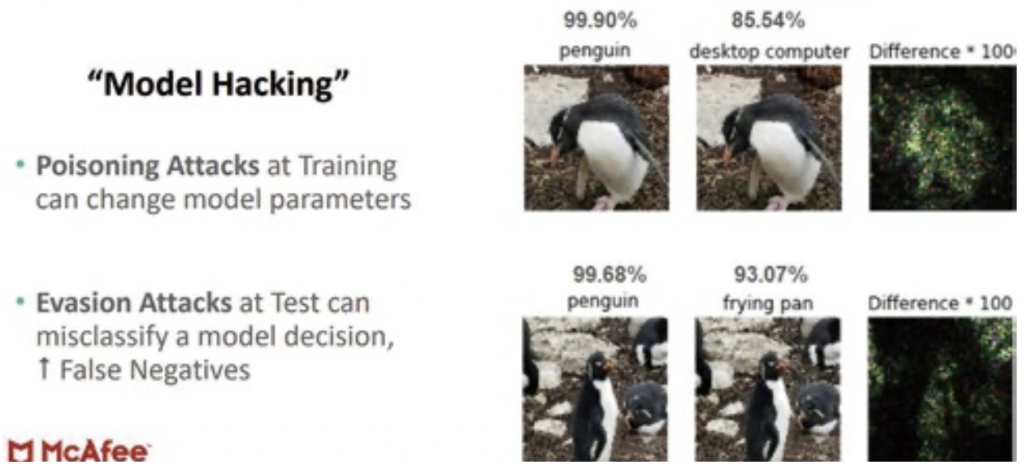

AI赋能网络安全同时,越来越多的议题开始关注机器本身的风险,数据安全、样本污染、识别系统混乱、软件漏洞等安全问题日益显现。本次RSA2020上,来自不同领域的安全专家围绕“AI与安全”的话题展开了讨论,AI自身存在安全问题,包括隐私数据窃取问题、学习框架和组件漏洞被利用等问题。

敏感数据的识别和防护是国内外最重要的合规性要求,安全大数据有必要处理好正常的个人数据隐私利用与个人隐私保护关系。RSA 2020创新沙盒冠军SECURITI.ai戳中了数据隐私保护这一全球性的难题和挑战,推出的Auti机器人自动化执行隐私保护,授予用户对数据的权利,成为用户数据的负责人和保管人,同时遵守全球隐私法规并建立与客户的信任。Intel Casimir Wierzynski指出AI和隐私结合不是零和博弈问题,而是对计算和存储资源都提出了更高要求。安全领域对隐私关注更多,围绕隐私保护框架和自动化实施方面也变得更具实操性。

RSA大会于2月27日下午对抗性AI的报告中给出了对真实AI系统的真实威胁和攻击示例。攻击者试图欺骗图像识别系统,了解系统的图像识别引擎如何工作后,找出有效欺骗的对抗样本并打破数学模型。同样,攻击者通过收集和处理大量安全数据,有效实施深度伪造攻击或欺诈网络安全中使用的AI模型。这两年我们开发对抗实验平台研究分析对抗样本攻击的经典算法,分析生成对抗样本的效率及其对深度学习模型的误导效果,为对抗样本检测和防御算法设计提供一定的技术基础,从而提供AI模型的鲁棒性。

AI在推动安全产业发展同时,也需要我们加强对潜在风险的研判和防范。AI数据样本、算法模型、框架平台等技术自身安全亟待加强,加强AI安全与治理前瞻研究,确保AI在不同领域中深入融合的安全发展和可靠应用。

总结

AI已经来临,安全亦在前行。面对AI,我们需要技术和监管共同发力,用其所长、避其所短,让AI在发挥最大优势的同时,防止其安全威胁,将AI与人类的关系维持在最佳状态。

绿盟科技作为一家网络安全公司,早已在不同安全产品中融入AI技术,同时做好AI技术发展背后的安全专家,提早对AI安全风险和应用威胁加强安全防范,确保AI技术的安全发展。