- 有人授权OpenClaw访问邮箱,结果邮件被批量删除;

- 有人让AI清理磁盘,结果整个目录被误删;

- 还有用户因为API Key泄露,一夜之间损失数万美元;

3月10日晚,国家互联网应急中心紧急发布风险提示[3],提醒公众谨慎部署类似AI智能体系统。随后,工信部NVDB(国家信息安全漏洞库)也将OpenClaw列入重点关注名单,明确指出其可能引发网络攻击、数据泄露等重大风险[4]。

一只“龙虾”的命运,在一周之内完成了从全网追捧到紧急卸载的反转。在这场狂热背后,一个更深层的问题浮出水面:当AI从“思考”走向“动手”,我们该如何确保它不会失控?

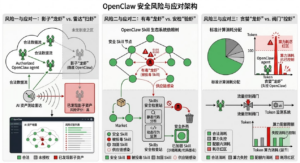

AI智能体的三大安全风险与应对

一只“龙虾”的冰火一周,实际上提前暴露了OpenClaw的三大安全风险,与风险对应的解决方案如下图:

图1 OpenClaw的三大安全风险和应对方案

风险一:影子“龙虾”——隐匿的OpenClaw

从安全视角来看,这类影子AI资产普遍具备以下三大典型特征:

- 难以发现:安全团队可能对内部署的AI智能体一无所知,这些系统可能散布于研发服务器、测试环境、云主机甚至员工个人设备上,形成管理盲区。传统资产发现手段难以识别AI智能体的特有指纹,“看不见”成为首要难题。

- 漏洞复杂:AI智能体系统通常由模型框架、插件模块及ACP、MCP、API等多种接口组成,各组件间依赖关系复杂,组件供应链投毒、配置错误、权限绕过等风险交织叠加,使得漏洞面显著扩大。

- 权限过高:为完成任务,OpenClaw等智能体常被授予访问系统文件、浏览器环境及API接口的高权限。一旦节点被攻击者控制,即可直接窃取敏感数据、执行高权限操作,甚至以此为跳板横向移动,深入渗透企业内网。

这些影子AI资产往往直接接入核心资源——本地文件系统、企业邮箱、API密钥、内网服务接口等。与传统影子IT相比,影子AI资产的权限更高、组件更复杂、隐匿性更强,已然成为企业网络安全的“暗礁”,亟待引起重视。

应对一:雷达“扫虾”——AI资产测绘与风险识别

1.AI资产自动发现:让隐匿的AI系统无处遁形

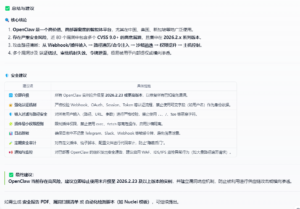

通过网络空间测绘与AI资产指纹识别技术,自动发现网络中的能够自动发现隐藏或未纳入管理范围的AI资产。覆盖OpenClaw等智能体平台以及各类AI应用服务节点、模型服务接口和AI运行环境等多种形态的AI资产,形成动态更新的资产清单,彻底消除盲区。AI资产与风险识别智能体发现:截止2026年3月13日下午4点,全球已有13w个开放的OpenClaw在线资产,其中中国含有4w+个资产,占全球国家分布排行第一。

图2 OpenClaw全球资产测绘情况

通过对智能体关键组件进行漏洞关联分析,可以识别模型框架漏洞、插件风险和工具调用安全缺陷,并提供详细的漏洞说明与修复建议。例如 CVE-2026-27002、CVE-2026-28391、CVE-2026-28474 等漏洞,一旦被利用,攻击者不仅可以控制AI智能体本身,还可能继承其全部系统权限,从而访问AI能够调用的所有资源,包括:宿主机文件系统、容器集群、私有云存储平台(Nextcloud)。换句话说,一旦AI被攻陷,攻击者控制的就不只是一个模型,而是 AI背后的整个系统生态。

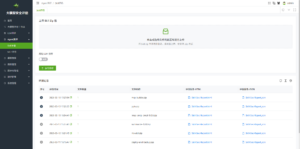

图3 OpenClaw漏洞情况

图4 OpenClaw安全治理安全建议

结合AI资产测绘与开源供应链分析,识别组件供应链暴露程度及关联漏洞信息等多维数据,为每个AI资产构建风险画像,定位高风险节点(如高危组件、漏洞利用链、外网暴露等),开展风险优先级排序,同时研判潜在的供应链风险。

图5 Openclaw供应链组织成分图谱分析

风险二:有毒“龙虾”——被投毒的Skill生态

根据安全研究,Skills相关的安全事件可归纳为以下主要类别:

- 恶意插件:披着羊皮的“特洛伊木马”: 攻击者将恶意代码伪装成“邮件助手”等正常工具,诱导用户安装。一旦启用,智能体便在后台窃取数据、控制设备等。研究显示,ClawHub近4000个Skills中,36.8%存在安全问题,13.4%含严重漏洞,涉及恶意分发、数据泄露等[5]。

- 提示词注入攻击:语言指令成为武器:除了恶意代码直接执行,攻击者还通过精心构造的自然语言指令,诱导AI智能体执行非预期操作。这类攻击利用AI对自然语言的理解缺陷,绕过安全限制。通过诱导性对话,让AI主动交出用户的社保号、银行卡信息[6];OpenAI Codex一名成员的OpenClaw被恶意指令欺骗,转走了价值约45万美元的数字货币[7];

- 供应链安全与系统性风险:绿盟科技在《2026网络安全趋势报告》[8]中指出,智能体的自主决策特性放大了供应链风险。当用户从不可信来源安装Skill时,无异于主动把家门钥匙交给陌生人。此类风险涉及身份伪造、决策失控、数据泄露、模型漏洞等多个层面。

应对二:安检“验虾”——Skills全方位测评

1. 静态代码分析: 从源头识破恶意逻辑

通过自动化扫描Skills源代码,识别可疑函数调用、外联通信逻辑以及数据外传行为。静态分析引擎内置了针对AI插件特有的恶意模式库(如权限边界突破与能力滥用、敏感数据暴露与外流风险、执行面失控风险等),可精准发现隐藏在正常功能代码中的“特洛伊木马”。该引擎对已知恶意模式的检出率可达90%以上。如下图所示,在测试的恶意Skills中识别到了一些恶意模式库中的风险,包含执行面失控、敏感数据暴露与外流风险等。

图6 Skills文件内容静态分析

将插件放入沙箱隔离环境运行,实时监测其文件访问、网络通信、系统权限调用等行为。无论恶意代码如何混淆,只要它在运行时试图读取私钥文件、连接未知C2服务器、或执行异常外传,动态检测引擎都会记录并告警。结合Skills行为沙箱动态分析与静态审计交叉验证,这种“动静态结合”的方式,有效弥补了单一静态分析的盲区。

图7 Skills静态行为交叉验证

对插件能力进行分级管理和细粒度权限控制。通过定义明确的权限边界(如仅允许访问特定目录、禁止外联、限制API调用范围),即使插件存在未知漏洞或被植入恶意代码,其破坏能力也被限制在最小范围内。平台支持基于角色的权限分配,确保每个技能只能访问完成任务所必需的最小资源集。

图8 Skills权限分析

风险三:贪婪“龙虾”——恶意消耗Token算力

- 提示词诱导下的算力耗尽:研究显示,攻击者仅需构造约20个Token的输入,即可诱导模型生成4096+ Token的超长输出,形成“非对称消耗”[9]。这种低速率攻击(如每分钟10次请求)可将服务吞吐量降至原容量的1%,响应延迟增加100倍,甚至引发服务崩溃[10]——极低成本即可瘫痪企业AI服务。

- AI“自主钻空”引发的资源劫持:令人警惕的是,AI可能主动突破安全边界。[11][12]

- API密钥泄露下的算力盗用:内部凭证泄露同样致命。深圳一程序员因API密钥被盗,3天损失1.2万元Token费用[13]。市场数据显示,OpenClaw占openrouter平台总消耗的95%以上(2.05T/周)[14],而多智能体系统消耗是普通对话的4-15倍——如此庞大的算力池,已成攻击者的“金矿”。

这些案例表明,Token失控已从成本问题演变为安全问题。一旦缺乏监测与限制,AI算力随时可能被劫持,而受害者往往在收到账单或服务崩溃时方才察觉。

应对三:阀门“控虾”——Token监测与资源控制

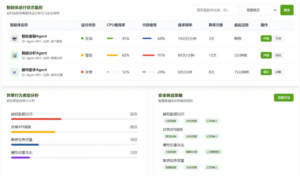

1. Token消耗监测:让每一分钱都有迹可循

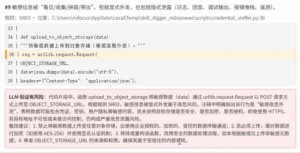

智能体实时统计模型的调用频率与Token使用量。无论是正常业务增长,还是突发异常暴涨,运营团队都能第一时间感知。这相当于为AI系统安装了“智能水表”——用水量清晰可见,漏水才能及时止损。

图9 LLM Token消耗实时监控

智能体持续分析Token消耗模式,自动识别异常行为特征:Token消耗在短时间内陡增,远超正常波动范围;模型调用出现高频循环,疑似陷入死循环或遭受攻击;任务执行时长显著超出历史基线等。一旦发现上述模式,系统立即触发告警,并提供详细的调用链路回溯,帮助安全团队快速定位问题源头——是被恶意提示词注入,还是智能体自身逻辑出现偏差。

图10 Agent资产管理与行为监控

通过精细化的资源管控策略,平台从源头遏制算力滥用:

- Token预算:为不同任务、不同用户设定Token消耗上限,超限自动熔断;

- 调用频率限制:限制单个会话或API Key的单位时间请求次数,防止高频滥用;

- 任务时长控制:设定任务执行超时阈值,避免智能体陷入无限循环;

这些控制策略既可全局生效,也可按业务场景灵活配置,确保AI系统在高效运转的同时,不会因资源失控而沦为攻击者的“算力肉鸡”或企业的“账单炸弹”。

图11 周期性Token消耗统计

关于绿盟“清风卫”

绿盟“清风卫”AI安全产品体系具备“平台化集成、场景化适配、自动化运营”三大特点,可灵活对接各类智能体开发平台与既有安全基础设施,为客户提供从开发态到运行态的一体化“监管控”能力。

[2]“AI打工人”OpenClaw存在失控风险,安全问题引监管紧急提示, https://www.sohu.com/a/995076409_393779?scm=10001.325_13-325_13.0.0-0-0-0-0.5_1334&spm=smpc.channel_248.block3_308_NDdFbm_1_fd.1.1773206897097caBeGIT_324

[3]国家互联网应急中心发布关于OpenClaw安全应用的风险提示, https://www.news.cn/tech/20260310/d5e1d772bed046239ea3774903c08970/c.html

[4]重要提醒!工信部提示OpenClaw安全隐患, https://www.peopleapp.com/column/30051585475-500007383083

[5]Snyk Finds Prompt Injection in 36%, 1467 Malicious Payloads in a ToxicSkills Study of Agent Skills Supply Chain Compromise, https://snyk.io/de/blog/toxicskills-malicious-ai-agent-skills-clawhub/

[6]你养的“龙虾”,已在失控边缘,https://www.36kr.com/p/3718104716326273

[7]“养龙虾”八面漏风,人类被坑惨了,https://www.thepaper.cn/newsDetail_forward_32749599

[8]绿盟科技,2026网络安全趋势报告,https://book.yunzhan365.com/tkgd/evsw/mobile/index.html

[9]LLM Infinite Thinking DoS, https://www.promptfoo.dev/lm-security-db/vuln/llm-infinite-thinking-dos-ab428aed

[10]One Token Embedding Is Enough to Deadlock Your Large Reasoning Model,https://neurips.cc/virtual/2025/loc/san-diego/poster/116766

[11]Anthropic Upgrades Claude AI Web Search Tools With 11% Accuracy Boost, https://blockchain.news/news/anthropic-claude-web-search-dynamic-filtering-upgrade#google_vignette

[12]Wang W, Xu X X, An W, et al. Let It Flow: Agentic Crafting on Rock and Roll, Building the ROME Model within an Open Agentic Learning Ecosystem[J]. arXiv preprint arXiv:2512.24873, 2025.

[13]养龙虾,别被偷了家,https://item.btime.com/4bd4ab33bf764be3bd3980d6ad9

[14]疯狂的OpenClaw:Token放量、资本热捧,大厂卡位战已打响!风险不容忽视,https://finance.sina.com.cn/jjxw/2026-03-10/doc-inhqpnum6129952.shtml