近日,RSA Conference正式公布RSAC 2023创新沙盒竞赛的10名决赛入围者,分别为AnChain.AI、Astrix、Dazz、Endor Labs、HiddenLayer、Pangea、Relyance AI、SafeBase、Valence Security、Zama。

4月24日(美国旧金山时间),创新沙盒将决出本年度冠军,绿盟君在此立足背景介绍、产品特点、核心能力等,带大家走进入围十强厂商,洞悉创新发展趋势。今天,我们要介绍的厂商是HiddenLayer。

一、公司介绍

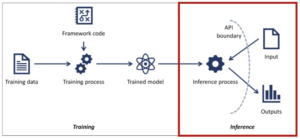

创始人团队来自Cylance,同样是一家网络安全领域的人工智能和机器学习创业公司,采用了深度学习等技术手段实现了恶意软件的分析能力。HiddenLayer官网给出了一个故事,说明了团队成立契机——源于2019年在Cylance发生的一次真实的对抗机器学习攻击事件。HiddenLayer创始团队成员发现,攻击者采用模型推断技术(Model Inference Attack),制造了可绕过Cylance恶意软件检测机器学习模型的恶意程序,并进一步控制了客户设备。可见,机器学习的威胁攻击面暴露并被利用的真实事件,是推动HiddenLayer团队成立创业公司的核心驱动力之一。

图1 典型模型推断攻击场景

二、技术背景介绍

人工智能技术的涵盖范围很广,包括机器学习技术、深度学习技术等各类数据科学和知识工程技术。人工智能的技术在各行各业的深入应用,以及数字空间、社会空间、物理空间的融合,使得人工智能的攻击面已逐渐渗透到更广泛的系统中。同时,人工智能技术栈涉及复杂的生命周期、部署框架与应用模式,其自身的攻击面风险的建模随之变得更复杂。

然而,传统网络空间威胁建模与威胁分析体系,主要面向传统网络空间攻击者、技战术、受害者、武器库等主要实体与关系分析。在威胁建模的范围上,缺乏针对人工智能系统关键要素,包括数据、算法、应用等维度的实体、关系范式适配,无法精确描述针对人工智能系统的攻击事件上下文;在威胁建模的方法上,缺乏对人工智能系统脆弱性缺陷、威胁攻击技战术描述、分类、交换方面的描述机制与共识,极大的限制了人工智能攻击面的识别、分析与风险分析。

随着人工智能技术的快速演进,人工智能风险对抗已成为国内外重要的研究领域。针对人工智能复杂攻击面风险的建模,我们可以参考以下几个重要的框架。

首先是MITRE构建的攻击面风险知识库ATLAS(Adversarial Threat Landscape for Artificial-Intelligence Systems),类似于MITRE ATT&CK,从攻击的视角,提供了描述人工智能攻击风险的技战术元语言词库。如图所示,ATLAS按照攻击阶段,划分了侦查(Reconnaissance)、资源开发(Resource Development)、初始访问(Initial Access)、机器学习模型访问(ML Model Access)、执行(Execution)、持久化(Persistence)、防御逃逸(Defence Evasion)、发现(Discovery)、收集(Collection)、机器学习攻击准备(ML Attack Staging)、数据外泄(Exfiltration)、影响(Impact)多个战术并给出了详细的技术词表,以及相关的技战术定义、缓解措施以及相关案例。

图2 MITRE ATLAS矩阵知识库

另外一个可用来描述人工智能系统风险的框架,是美国国家标准技术研究所NIST于2023年1月最新发布的Artificial Intelligence Risk Management Framework (AI RMF 1.0)。该框架将从Plan and Design、Collect and Process Data、Build and Use Model、Verify and Use Model、Verify and Validate、Deploy and Use、Operate and Monitor以及Use or Impacted这7个生命周期,给出了涉及的人工智能的风险验证关键过程和利益相关人员。

该框架不同于MITRE ATLAS,AI RMF 1.0从开发构建的DevOps流程的角度,即从AI应用的拥有方给出了风险暴露面及其管理机制。

图3 《AI RMF 1.0》中的人工智能风险生命周期和责任归属

图4 中国信通院的《人工智能安全框架(2020年)》

三、HiddenLayer技术分析

- MLDR,机器学习威胁检测与响应。能够提供实时威胁检测,提供包含告警、隔离、画像和误导(misleading)等响应操作,支持你可配置的精调选项。

- Model Scanner,模型扫描器。能够提供脆弱性识别,失陷模型识别,以及恶意代码注入的检测。

- Security Audit Reporting,安全审计报告。全面的报告AI/ML资产风险状态,可定制的仪表盘和报告功能,以及脆弱性的分级功能等。

- 威胁建模(THREAT MODELING) 通过综合的调研和攻击预演,全面的评估业务需求和AI/ML威胁攻击面。通过场景化的分析,评估整体的AI/ML环境和资产风险,可以交付相关系统的威胁向量、可能性、影响、受影响的资产以及缓解和恢复工作。

- 机器学习的风险评估(ML RISK ASSESSMENT) 分析机器学习模型的整个运营流程,并深入分析关键模型的风险,提供机器学习技术的投资风险分析。

- 专家培训(EXPERT TRAINING) 为数据科学和安全团队提供了解AML TTP(针对机器学习的威胁、战术和程序)和最有效的对策来保护系统免受这些威胁的影响。

- 红队评估(RED TEAM ASSESSMENT) 通过攻击渗透团队(Adversarial Machine Learning Research, AMLR)进行实战化攻击渗透进行现有的机器学习系统防御有效性。

- 人工智能/机器学习的模型扫描(AI/ML MODEL SCANNING) 使用其模型完整性扫描器来测试和确认现有相关模型的被攻陷、被篡改等风险。

- MLDR实现服务(ML DETECTION & RESPONSE (MLDR) IMPLEMENTATION SERVICES) 提供其无侵入式MLDR软件的集成服务。

图5 HiddenLayer的ATLAS风险矩阵覆盖情况

图6 HiddenLayer MLDR平台展示

HiddenLayer提供的MLDR,是一种轻量级的、外挂式无侵入的软件防护系统,不依赖机器学习模型的“内生安全”机制。MLDR产品包含两个部分:本地安装的客户端和基于云的分析端,客户端通过API与云端传感器通信。客户端部署在客户的环境中,类似防火墙集成到机器学习模型服务流程中,并将所有模型查询的输入向量以及相应的预测发送到HiddenLayer 的云端API。然后,该数据用来分析以检测恶意或可疑活动。如果检测到任何这样的活动迹象,则会以所选择的方式将警报发送回给客户,可以集成到Splunk、DataDog、HiddenLayer UI或客户端命令行脚本。

图7 HiddenLayer MLDR框架

- 在检测机制层面,具体的方法我们不得而知,官方博客中显示其技术是启发式方法和机器学习分析技术的融合方法。

- 在告警机制层面,如前所述,能够将检测告警映射到MITRE ALTAS机器学习攻击风险矩阵当中,并统一集成到各类SIEM平台。

- 在攻击响应层面,MLDR可以实现1)限制特定模型或请求者的访问速率或封锁恶意访问;2)改变分类分数以防止梯度/决策边界的发现;3)将流量重定向并对攻击进行持续画像;4)引入人类干预,支持手动分类和响应。

图 8 HiddenLayer MLDR检出Malware生成的恶意样本

四、总结

站在ChatGPT的人工智能发展的风口上,HiddenLayer给出了相对完整、可信的人工智能/机器学习模型及系统安全解决方案,为此笔者相信,HiddenLayer将是本界RSA创新沙盒冠军的有利冲击者。

[2] https://hiddenlayer.com/

版权声明

本站“技术博客”所有内容的版权持有者为绿盟科技集团股份有限公司(“绿盟科技”)。作为分享技术资讯的平台,绿盟科技期待与广大用户互动交流,并欢迎在标明出处(绿盟科技-技术博客)及网址的情形下,全文转发。

上述情形之外的任何使用形式,均需提前向绿盟科技(010-68438880-5462)申请版权授权。如擅自使用,绿盟科技保留追责权利。同时,如因擅自使用博客内容引发法律纠纷,由使用者自行承担全部法律责任,与绿盟科技无关。