聚焦网络安全新热点,洞悉安全发展新趋势。与绿盟君一道,走进Geordie AI。

01公司简介

图1 Geordie AI官网

图2 Geordie AI创始人

02行业背景与产品解决的核心痛点

首先,企业普遍缺乏对 AI Agent 的 统一可视化管理能力。当前 AI Agent 可能分布在不同环境中,例如 SaaS 平台中的智能助手、开发者在代码中构建的 Agent,以及运行在员工终端设备上的 Agent 等。这些智能体通常跨越不同框架和平台运行,使得安全团队很难获得一个完整的视图来了解组织内部到底部署了多少 Agent、它们运行在哪些系统中以及由谁创建和使用。这种可见性不足的问题使得企业难以建立统一的智能体资产管理体系,也无法对其风险进行有效评估。

其次,企业难以持续理解 AI Agent 的 能力边界和权限范围。在很多场景中,AI Agent 的角色类似于“数字员工”,它们能够调用多种业务工具并访问企业内部数据。但在实际运营中,大多数企业只会在 Agent 接入系统时进行一次简单的风险评估,随后便缺乏持续的能力审计机制。企业往往无法准确掌握这些智能体可以调用哪些工具、访问哪些数据以及正在执行哪些业务任务,导致部分 Agent 可能在不知情的情况下拥有过高权限,从而形成潜在安全隐患。

第三,AI Agent 的 行为具有非确定性,这使得传统安全监控方式难以适用。智能体在执行任务时会根据上下文信息自主做出决策,其行为路径可能随环境变化而不断调整。因此,企业需要持续监控 AI Agent 在真实业务流程中的操作行为,例如它们每天执行哪些任务、是否按照预期流程运行以及是否存在异常行为。然而在目前的技术环境下,大多数企业缺乏针对 AI Agent 的行为可观测能力,无法对其运行过程进行持续审计和追踪。

此外,随着 AI Agent 不断接入新的系统、工具和数据资源,其 风险面(Risk Surface) 也在持续扩大。智能体可能在执行任务过程中访问敏感数据、调用未授权工具或因上下文被操控而做出错误决策,从而引发数据泄露、越权访问等安全问题。同时,由于 AI Agent 之间可能存在协作关系,一旦某个智能体出现异常行为,还可能引发级联故障或业务流程中断。这些风险在传统安全体系中难以及时识别和评估。例如最近爆火的openclaw,用户在本地部署 Agent 时往往授予其读取文件、执行命令和访问账号的权限,安全研究人员发现这些 AI Agent 在自动执行任务时,会批量创建虚假账号并传播诈骗内容 [4][5]。

最后,传统安全产品往往难以有效应对 AI Agent 带来的新型风险。现有安全体系(如 IAM、SIEM、EDR 等)主要针对人类用户或传统应用设计,而 AI Agent 具有实时决策和自主执行能力,很多情况下甚至不存在可以直接“终止”的控制点。如果继续依赖传统的检测与响应方式,往往难以及时阻止智能体在运行过程中产生的风险。因此,企业需要一种专门面向 AI Agent 场景设计的安全与治理解决方案,能够在智能体运行过程中持续监控其行为、评估风险并提供策略化控制能力。

在这一背景下,Geordie AI 提出了面向 AI Agent 的安全治理平台,通过自动发现企业内部运行的智能体、持续分析其能力与行为,并建立统一的风险评估与策略控制体系,帮助企业解决 AI Agent 在可见性、行为监控、权限管理和风险治理等方面的核心问题,从而在保证安全与合规的前提下推动智能体技术在企业中的规模化应用。

03核心产品深度解析

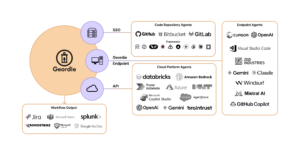

图3 Geordie架构图

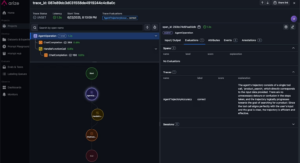

从实现角度来看,该能力很可能通过在 AI Agent 运行环境中部署轻量级采集组件,对 Agent 的关键行为事件进行实时记录。例如,系统可以对模型推理调用、工具调用、API 请求以及数据访问行为进行事件捕获,并通过统一的日志或事件管道汇聚到中央控制平台。随后平台通过资产识别与关联分析技术,对不同系统中的 Agent 实例进行统一建模,构建企业级 Agent 资产图谱,从而实现跨平台的统一可视化与管理。这种技术思路与当前 AI 应用可观测性平台的实现方式较为类似,例如 LangChain 提供的可观测性平台 LangSmith [6],以及 Arize AI [7]在 LLM 调用链追踪与行为监控方面所采用的技术架构。

图4 LangSmith agent观测平台

图5 Arize AI的某个agent trace和评估

在技术实现上,这种能力可能依赖于在 Agent 执行流程中嵌入策略决策层(Policy Decision Layer)。系统通过分析任务上下文、用户身份、数据敏感级别以及工具权限范围等信息,动态生成执行策略。当 Agent 发起工具调用或敏感操作请求时,策略引擎会对其进行实时评估,并根据策略规则对请求进行放行、限制或阻断。此外,系统还可能结合语义分析与任务理解能力,对潜在风险操作进行提前识别,从而实现更细粒度的治理控制。一些 AI 安全厂商(如 Lakera)已经在他们的产品中引入了类似的技术机制,在 LLM 或 Agent 调用链中引入实时策略控制与 Guardrail 机制 [8]。

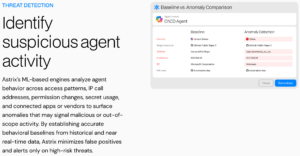

在实现层面,该能力可能通过持续采集 Agent 的执行日志、工具调用序列以及决策路径信息来构建行为基线模型。当系统检测到与历史模式明显不同的行为特征时,会自动触发异常检测机制,对潜在风险行为进行标记与告警。同时,平台还可以通过工作流分析技术对多智能体之间的协作关系进行建模,从而识别复杂任务链路中的异常节点或潜在风险传播路径。这种基于行为模式的安全监控方法在 AI 安全领域已经开始出现,例如 Astrix Security [9] 等厂商在 AI 应用安全平台中提出的行为监控与风险检测机制,其技术思路与传统安全领域的 UEBA(User and Entity Behavior Analytics) 模型也具有一定相似性。

图6 Astrix Security通过基线识别可疑的agent行为

从架构角度来看,Beam 很可能在 Agent 决策链路中引入实时风险评估模块,对智能体即将执行的操作进行动态评分。当系统识别到潜在高风险行为时,可以通过调整上下文提示、限制工具调用参数或替换执行路径等方式对 Agent 决策进行修正。这种机制本质上将安全控制嵌入到 Agent 的执行逻辑之中,使系统能够在任务执行阶段而非事后检测阶段进行风险干预。类似的安全理念在 AI 安全研究中也逐渐受到关注,例如 Anthropic 在 AI 安全研究中提出的模型决策约束机制 [10],以及 Protect AI [11] 所提出的 AI Runtime Protection 技术方向,都强调在模型决策阶段对潜在风险进行实时干预。

从技术实现角度来看,这种快速接入能力很可能依赖于轻量级的集成方式,例如 SDK、API 网关代理或插件化组件,使平台能够在不改变现有系统架构的情况下接入企业的 AI Agent 运行环境。例如,在代码开发型 Agent 场景中,系统可能通过 SDK 或中间件方式接入 Agent 框架,从而捕获工具调用和推理事件;在 SaaS Agent 或企业应用场景中,则可能通过 API 集成或身份代理方式实现行为监控与策略控制。此外,在云环境中还可能通过容器侧车(Sidecar)或代理网关方式实现统一的数据采集与策略执行。这类插件化与可插拔的接入模式在当前 AI 应用生态中较为常见,例如 LangChain 提供的框架集成机制,以及 OpenAI 和 Anthropic 等平台所支持的 API 与工具调用接口生态,都使第三方安全平台能够较为容易地接入和监控 AI Agent 的运行行为。

从整体架构来看,Geordie 实际上试图构建一层新的安全能力,即 AI Agent Runtime Security(智能体运行时安全层)。通过可视化、策略治理、行为监控与风险缓解等能力,该平台能够在 AI Agent 执行任务的整个生命周期中提供持续的安全控制。

04总结

Geordie AI 正是在这一背景下提出其 AI Agent 安全与治理平台,通过统一的智能体资产发现、行为可观测、风险评估和策略控制能力,为企业提供面向智能体运行环境的安全管理框架。该平台能够帮助企业识别组织内部的 AI Agent 生态,持续监控其行为与权限变化,并对潜在风险进行及时发现与治理,从而提升企业在大规模部署 AI Agent 时的安全可控性。

从行业发展趋势来看,随着企业对 AI Agent 的依赖程度不断提升,围绕智能体的安全治理也将逐渐成为 AI 安全领域的重要方向。未来,AI Agent Security 有望像云安全和身份安全一样,发展为企业安全体系中的关键组成部分。Geordie AI 作为该领域的早期探索者,其技术路线和产品思路为行业提供了一种新的参考,也反映出安全行业正在向“面向智能体的安全治理”方向持续演进。

参考文献:

[2] https://finance.yahoo.com/news/geordie-exits-stealth-6-5m-100000822.html?guccounter=1&guce_referrer=aHR0cHM6Ly93d3cuZ29vZ2xlLmNvbS8&guce_referrer_sig=AQAAAGsJIO3cyRh9GKjXp3bjZe-AdLVg3EsADkFHZCTrRSkkMBfKbAjTRU686A8nwca-Z9G9TDO3F2DnfgtxE2kgJ7tJ9A_ic7JukqGvH7B1uyatu5p77VMJO37a2ad81s-FpytKLdCwUWwr3J5Q2el6QmauK06NMP2zszVLoLC7Pkip#

[3] https://www.geordie.ai/product

[4] https://cyberstrategyinstitute.com/openclaw-risks-autonomous-ai-agents/

[5]https://mp.weixin.qq.com/s/FlhMmYf0YNsj2FCzqHiE8g

[6] https://www.langchain.com/langsmith/observability

[7] https://arize.com/ai-agents/agent-observability/

[8] https://docs.lakera.ai/guard

[9] https://astrix.security/product/secure-ai-agents/

[10] https://arxiv.org/abs/2212.08073

[11] https://protectai.com/