阅读: 627

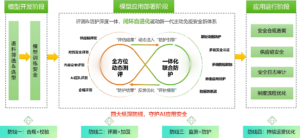

AI Agentic应用安全防护体系的构建需要系统性的方法论指导。绿盟科技提出的“四道防线”理念,从模型生命周期的源头治理到持续运营,形成了完整的安全闭环。这一框架并非简单的技术堆叠,而是将安全能力嵌入智能体应用的每一个关键节点,实现“安全左移”与“持续防护”的有机结合。四道防线分别对应模型选用与开发、应用安全上线、全场景纵深防御以及常态化安全运营四个核心阶段,每道防线都包含具体的技术手段、管理流程和度量指标,确保安全防护的可落地性与可验证性。

第一道防线:“合规与校验守护模型选用和开发”聚焦于大模型应用的起点,解决“源头安全”问题。在企业决定引入大模型能力时,首先面临的是模型选型决策:是采用经过备案的商业大模型服务,还是基于开源模型自主部署?无论哪种选择,都需要建立系统性的安全评估框架。对于商业模型服务,企业应核查服务提供商的算法备案状态、风险评估报告完整性,并在服务级别协议(SLA)中明确安全责任边界、数据处理方式、漏洞响应时限等关键条款。特别需要关注的是数据主权问题,若服务涉及跨境数据传输,必须评估是否符合《数据出境安全评估办法》等法规要求。对于开源模型自主部署方案,安全挑战更为复杂:企业需要对模型权重文件进行完整性校验,防止下载过程中被篡改或植入后门;对推理框架及其依赖组件开展漏洞扫描;对模型文件本身进行投毒检测,识别可能存在的恶意触发器或隐藏功能。这一阶段的另一项核心工作是构建AI-SBOM(人工智能软件物料清单),这是传统SBOM在AI场景的延伸与扩展,需要覆盖模型应用层面(基座模型版本、微调适配器、LoRA权重、智能体开发框架等)、数据层面(训练语料来源、标注数据质量、知识库更新机制)、工具链层面(训练框架版本、推理引擎配置、部署工具参数)以及运行时层面(容器镜像构成、系统库依赖、硬件驱动版本),形成完整的资产台账与风险地图。

第二道防线“多维度评测保障模型应用安全上线”解决“准入安全”问题。即使源头安全得到保障,大模型应用在正式上线前仍需经过严格的安全评测。这一防线强调“测评驱动安全”,通过自动化工具与人工评估相结合的方式,全面识别潜在风险。自动化合规测评需要对标国内外最新标准规范,包括国家标准GB/T 45654-2025《信息安全技术 生成式人工智能服务安全基本要求》、TC260-004《政务大模型应用安全规范》、通信行业标准YD/T 6520-2025《生成式人工智能服务安全能力要求》、AI安全治理框架(WTDA)、MITRE ATLAS(对抗性机器学习威胁矩阵)、NIST AI风险管理框架(AI RMF)以及OWASP LLM Top 10等。测评内容涵盖内容安全(有害信息生成、偏见歧视、价值观对齐)、对抗安全(提示词注入、越狱攻击、多轮诱导)、供应链安全(依赖漏洞、许可证冲突、后门植入)等多个维度。安全风险评估则需要依托OWASP Top 10 for Agentic Applications 2026等框架,围绕模型安全、数据安全、内容安全、应用安全、运行安全、AI供应链安全等高风险场景开展深度评估。AI红队评估是这一防线的高阶实践,从真实攻击者视角出发,系统性评估人工智能系统在全生命周期各阶段的安全性,识别模型缺陷和防护机制漏洞,并提供可落地的修复建议。

第三道防线“打造覆盖全场景纵深防御体系”解决“运行安全”问题。通过安全评测的应用上线后,仍需面对复杂多变的运行时威胁。这一防线强调“纵深防御”理念,通过多层、异构的防护机制,确保单点失效不会导致整体防线崩溃。基础设施防护层面,推荐采用集约化部署架构,实施集中统一的安全管理与体系化防护,对部署所需的软硬件开展持续安全监测,跟踪漏洞信息并及时修复加固。网络层面加强隔离与访问控制,精准配置软件参数,禁用非必要端口与服务。多级安全认证层面,需要建立涵盖用户身份、智能体身份、模型身份的多实体认证能力体系,确保各参与方身份真实可信,并遵循最小权限原则设置访问权限,按业务场景限制调用频率,对高风险操作实施双人复核或熔断机制。多级围栏联防层面,部署AI安全围栏能力,基于多维度安全检测模型,实时识别并拦截违法不良信息、敏感有害问答、提示词注入攻击等威胁,支撑模型应用的内容合规、攻击防御与数据保护需求。原生应用安全层面,构建精准的流量解析能力以识别异常访问模式,深度监测应用行为以阻止恶意操作,建立API接口全生命周期管控机制以防止数据泄露,并依据威胁情报实时更新防护策略库。数据泄露防护层面,针对大模型输入、输出内容实施指令攻击防护、敏感数据阻断、动态脱敏等措施,构建全流程可控、风险可防的数据安全防护能力体系。

第四道防线“常态化开展安全运营”解决“持续安全”问题。安全防护不是一次性项目,而是需要持续投入、持续优化的长期工程。这一防线强调“运营驱动改进”,通过建立完善的安全管理体系、安全态势监测能力、AI供应链安全管理机制以及合规运营流程,确保安全能力的持续演进。安全管理体系建设层面,制定符合业务发展的大模型安全方针与政策,明确整体目标和方向;制定涵盖语料规范、应用开发、应急响应等领域的制度规范,形成可执行的操作指南。安全态势监测能力层面,持续监控、评估并增强AI服务与数据的安全性,涵盖AI资产管理、运行时监测、智能体行为分析等关键组件,加强安全审计能力建设,提升大模型关联风险的识别和管控水平。AI供应链安全管理层面,严格遵循法规要求开展内外部审计,规范组件采购流程并做好安全加固,搭建实时监测体系及时发出预警,制定完备应急预案并定期演练,开展供应链产品测评以优化整体效能。合规运营层面,完成大模型应用合规评估、算法备案和上线备案等法定程序,采购必要的合规测评服务、人工评估服务、资料审核服务和资料指导服务,确保“备案、标识”双合规。

绿盟科技作为国内领先的网络安全企业,在大模型安全领域构建了完整的产品服务体系,支撑客户的安全能力建设,核心产品与技术能力如下:AI-Scan:自动化合规测评平台对标GB/T 45654-2025、YD/T 6520-2025、NIST AI RMF、MITRE ATLAS、OWASP LLM Top 10等国内外标准,提供内容安全检测、对抗安全测试、供应链安全扫描三大能力模块。平台支持自定义测评策略、生成详细报告、与CI/CD流程集成,实现“测评左移”。AI-GR:AI安全围栏基于多维度安全检测模型,在输入层、中间层、输出层实施全链路监控。核心技术包括:提示词注入检测模型,持续对抗训练识别新型攻击;语义理解与意图识别,超越关键词匹配识别隐蔽威胁;生成内容事实性验证,结合知识库和置信度评估抑制幻觉。

AI-UTM:AI安全一体机是面向大模型应用场景的 一体化安全网关,融合了AI安全围栏的全部检测能力,并额外集成了AI网关(算力管控、模型路由)、传统网络安全(WAF、IPS、防病毒)以及大模型安全评估等全方位防护能力。

NSF-ClawGuard(新):作为聚焦类OpenClaw智能体安全开源插件,可与AI安全围栏或绿盟AI安全一体机联动,形成“端侧实时拦截+围栏或一体机深度研判”的纵深防御体系,插件在OpenClaw主机侧基于规则库和情报运行检测,安全围栏或一体机基于模型对OpenClaw的意图、行为进行深度安全检测和风险行为拦截。

NSF-ClawGuard安全插件典型功能界面如下:

事件概览页面直接展示了风险类型分布、威胁等级分布和近7天趋势:

安全通过率和具体的安全事件详情也能一目了然,每条事件都带了处置建议:

Token消耗页面能看到每个会话用了哪个模型、输入输出各多少、缓存命中率:

安全通过率和具体的安全事件详情也能一目了然,每条事件都带了处置建议:

AI Red Team:红队评估服务由资深安全专家组成,从攻击者视角系统性评估AI系统安全。服务涵盖:威胁建模与攻击链构建,识别高价值攻击目标;自动化与手工渗透结合,覆盖已知和新型攻击向量;社会工程学与多模态攻击,测试人员安全意识和技术防护;全生命周期覆盖,从预训练到运营的各阶段风险评估。

AI Agentic应用安全防护是一项系统工程,需要技术、管理、运营的协同,需要企业、行业、政府的协作,需要持续的创新和迭代。绿盟“四道防线”理念提供了一个可扩展、可演进的框架,但具体的实施需要结合组织的实际情况,因地制宜、因时制宜。面对AI技术的快速发展和安全威胁的不断演变,保持学习的姿态、开放的心态、务实的作风,是建设有效安全防护体系的关键。