本篇我们将目光转向容器化沙箱的底层隔离边界,剖析CVE-2026-32038。该漏洞源于OpenClaw Gateway在创建沙箱容器时,对Docker网络命名空间共享机制的审计存在盲区。本文将通过模拟真实的业务场景,构建自动化靶场环境,展示攻击者如何利用container:<id>语法,从受限的沙箱环境横向移动,窃取仅监听于本地回环地址的敏感数据库凭据。

关键词:OpenClaw漏洞;CVE-2026-32038;沙箱逃逸;网络隔离绕过;Docker安全

注:本文及相关靶标构建方法仅用于安全研究与防御体系学习,请勿将相关技术用于任何未经授权的非法测试网络。

一、背景与机制解析

1.1 组件架构:Sandbox与Exec的安全底座

1. Exec(审批层):负责定义智能体调用系统命令的审批逻辑。通过safeBins白名单和ask策略(如on-miss),决定哪些操作可以自动化执行,哪些必须经过人工确认。

2. Sandbox(隔离层):这是OpenClaw的核心安全防护屏障。Sandbox可通过Docker或MicroVM技术,为每个任务创建一个临时的、受限的执行环境,防止模型执行如rm -rf /或反弹Shell等高危指令。

核心配置详解:在openclaw.json的agents配置项中,sandbox模块控制着隔离的强度,其主要配置如下所示:

mode:定义隔离级别(如all表示全量隔离)。

workspaceAccess:限制沙箱对宿主机工作目录的访问权限。

docker.network:(本次漏洞核心)定义沙箱的网卡模式。默认情况下,为了实现完全隔离,该参数应严禁指向宿主机或其他业务容器。

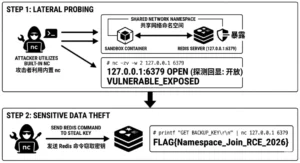

1.2 靶场场景构建:幽灵连通性

模拟场景描述:某科技公司的运维团队为了调试生产缓存redis的响应延迟,临时修改了Agent配置。由于网关在处理docker.network参数时,仅防御了常规的–network=host,却忽略了利用Docker网络命名空间共享特性的攻击路径,导致一个名为“幽灵连通性”的逻辑后门被植入系统。攻击者的目标是利用此边界缺陷,绕过沙箱限制,窃取Redis中存储的生产环境备份密钥。

二、CVE-2026-32038深度剖析

2.1 漏洞基本信息

2.2 防御机制的底层语义盲区

在旧版本代码中,网关仅对network参数实施了简单的黑名单策略,主要是为了防止Agent加入宿主机网络:

//脆弱的审计逻辑示例if(config.network==='host'){thrownewError('Hostnetworkisforbiddeninsandbox!');}

然而,Docker支持一种隐蔽的共享模式:–network=container:victim-container。当此参数生效时,新容器不会创建自己的网络协议栈,而是直接复用目标容器的网卡、IP以及回环地址。由于审计层不认为container:<字符串>是危险的,载荷被顺利放行。此时,原本处于完全隔离状态的沙箱,在网络层面上已与受害者容器完全合并,实现了“幽灵式”的连通[2]。

三、自动化靶场环境搭建

3.1 核心环境依赖

| 组件 | 版本 | 角色 |

| OpenClaw | 2026.2.23 | 漏洞承载环境 |

| Docker | 20.10.x+ | 基础设施 |

| Redis | latest | 受害者服务(模拟生产环境) |

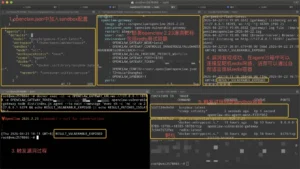

3.2 漏洞环境部署

docker run -d –name victim-service redis:latest redis-server bind 127.0.0.1docker exec victim-service redis-cli SETBACKUP_KEY"FLAG{Namespace_Join_RCE_2026}"

第二步:配置脆弱的OpenClaw Agent修改openclaw.json,将沙箱网络模式指向受害者容器:

"sandbox": {"docker": {"image": "busybox:latest","network": "container:victim-service"}}

四、漏洞复现与利用

4.1 攻击路径演示

步骤2:敏感数据窃取通过Redis协议提取备份密钥

4.2 利用效果

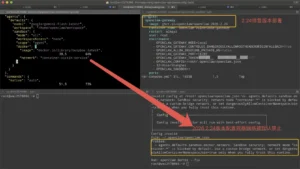

五、安全防护最佳实践

1. 内核防御:升级版本立即升级至OpenClaw 2026.2.24以上版本。官方在最新的安全公告中指出,该版本已重构了DockerDriver.ts的参数校验模块,通过正则白名单强制拦截任何未经显式授权的container:命名空间加入请求[2]。笔者也尝试通过升级版本再复现该漏洞,发现配置容器网络行为被默认禁止,如下图所示:

3. 零信任准入:即便对于内部Agent的配置变更,也应通过Exec审批流进行二次人工确认,防止通过配置篡改实现“幽灵连通”。这一部分内容也可以参考之前的《POSIX缩写绕过安全白名单(二)》系列文章,其中有详细说明。

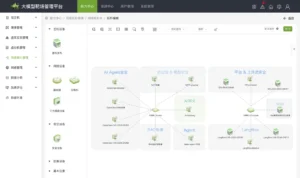

绿盟科技星云实验室已将该复现逻辑集成于AI靶场

AI系统对外部环境的威胁场景:在这一类场景中,靶场重点还原大模型被纳入系统后,其输出结果被自动采信并直接作用于外部环境(本地终端与开发机、浏览器与IDE、云原生基础设施等等)所形成的真实攻击路径。该类威胁并非源于模型本身的缺陷,而是源于模型能力与外部环境执行能力之间缺乏有效安全边界。

外部环境对AI系统威胁场景:在此类威胁场景中,靶场重点关注外部环境如何成为攻击大模型的关键跳板。攻击者不再局限于通过提示词影响模型输出,而是借助外部环境中的执行能力、逃逸路径、供应链环节与控制面权限,从运行环境、权限体系与数据上下文等多个层面,直接接管或长期影响大模型的行为。

AI系统自身的内生安全风险场景:如输入与指令安全、输出与交互安全、数据与知识安全、自治与资源治理安全。